Il report di Alliance4Europe e Trollrensics

Dall’Olanda all’Ungheria, passando per X: stessa infrastruttura, stessi segnali, nuova elezione da colpire. Dietro profili apparentemente locali, nomi plausibili e contenuti in lingua nazionale, il report Persistent Infrastructure and Cross-Border Influence Operations Targeting European Elections on X, realizzato da Alliance4Europe e Trollrensics, ricostruisce il riuso di una rete di account falsi, già attiva durante le elezioni olandesi del 2025, per amplificare contenuti pro-Orbán, pro-russi e anti-establishment in vista del voto ungherese del 2026.

Non si tratta solo di propaganda o di semplice spam politico: la manipolazione non passa solo dai contenuti, ma anche dai follower, dalle interazioni e da tutti quei segnali che gli algoritmi leggono come prova di popolarità.

L’indagine parte dalle elezioni parlamentari olandesi del 29 ottobre 2025. In quel contesto, RTL Nieuws e Trollrensics avevano individuato oltre 550 account falsi su X, responsabili di più di 23 mila post, in larga parte retweet di contenuti politici in lingua olandese.

Secondo il report, la rete amplificava soprattutto contenuti vicini a Forum for Democracy (FvD), partito olandese guidato da Thierry Baudet, e in misura minore post riferiti a Geert Wilders e al PVV, il Partito per la Libertà olandese.

Ma il punto più interessante è il metodo. La rete non si limitava a rilanciare post: seguiva in massa piccoli account anonimi, iperattivi e polarizzanti, gonfiandone artificialmente i followers e accrescendo autorevolezza percepita e probabilità di essere raccomandati dall’algoritmo. In pratica, non puntava solo a rendere virali dei contenuti, ma a costruire l’illusione di una rilevanza organica. È una forma di manipolazione più sottile, perché agisce sotto il livello visibile della conversazione pubblica.

Gli autori segnalano inoltre diversi indicatori di inautenticità: profili con nomi olandesi improbabili, bio in lingua locale ma localizzazioni incoerenti, raffiche di retweet concentrate in pochi minuti, account che cambiavano nome, username e immagine durante il monitoraggio.

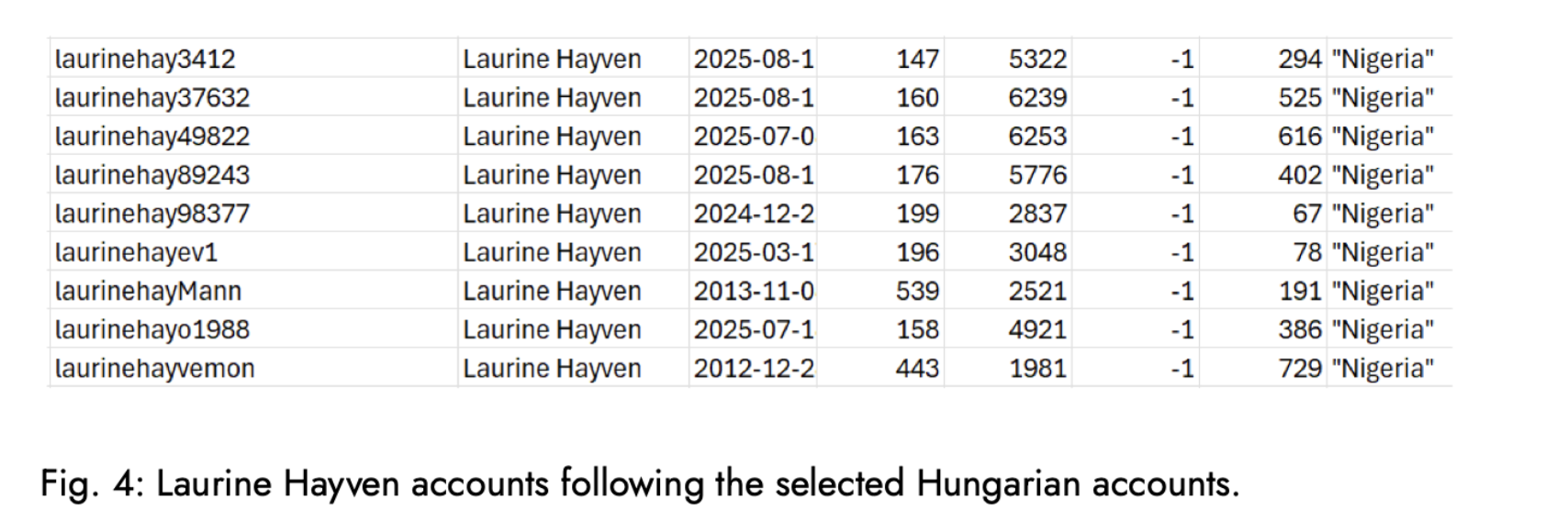

In alcuni casi venivano persino imitate figure pubbliche o identità ricorrenti, come nel caso delle molte varianti costruite attorno al nome “Laurine Hayven”.

Il report mostra poi come parte di questa stessa infrastruttura sarebbe stata riattivata nel passaggio al caso ungherese.

Tra fine marzo e inizio aprile 2026, diversi account già osservati nel contesto olandese risultavano seguire in modo sistematico profili ungheresi favorevoli a Viktor Orbán o portatori di messaggi filo-russi ed euroscettici. L’analisi si è concentrata su 21 account ungheresi particolarmente beneficiati da questa attività.

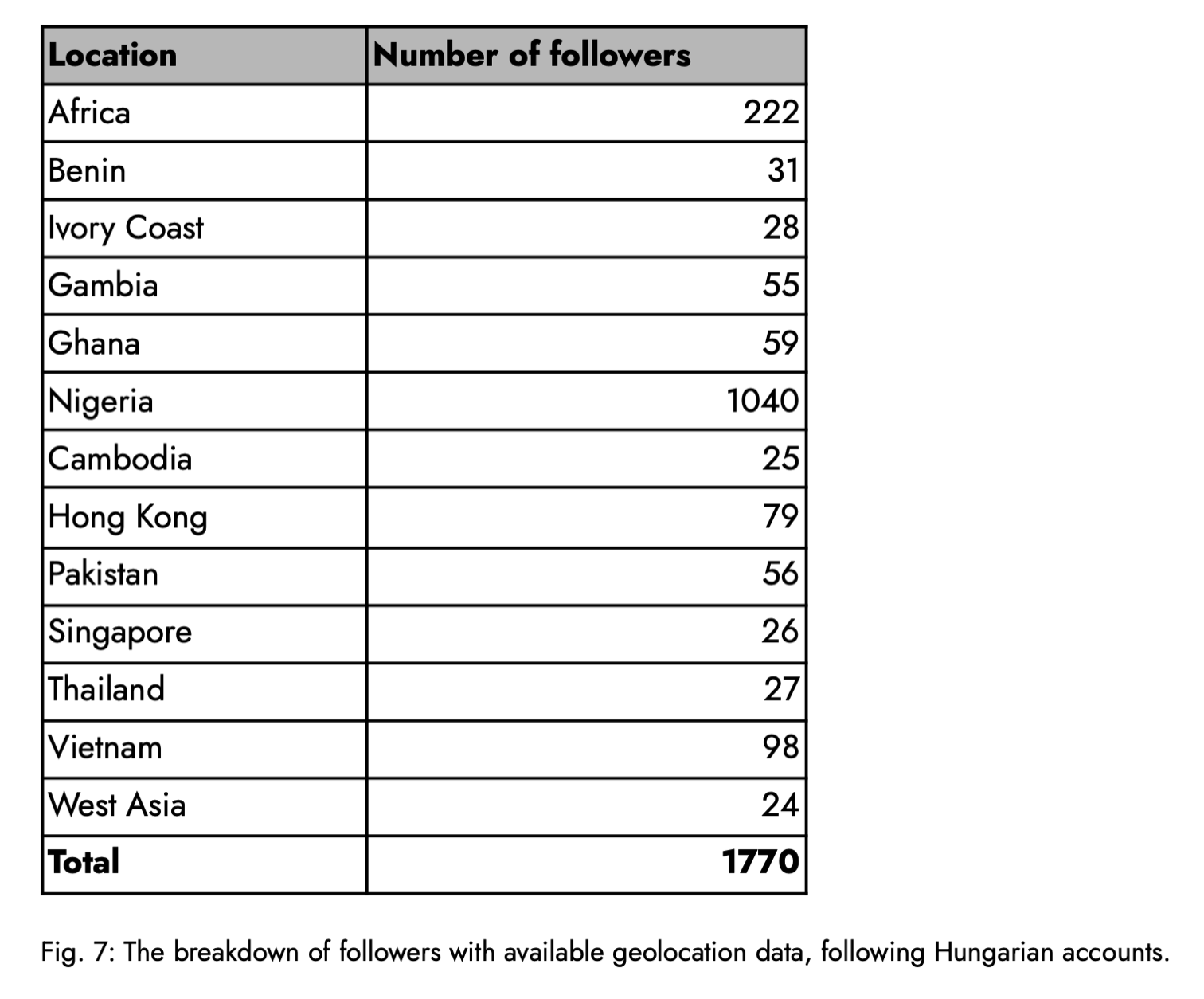

I dati sono piuttosto netti. Tutti e 21 gli account risultavano seguiti da profili geolocalizzati in Nigeria; il totale dei follower attribuiti a questo cluster era di 1.040 account. Sommando anche altri profili provenienti da Africa occidentale e Asia, il numero saliva a 1.770.

Tra i pattern osservati, il report distingue diverse tipologie ricorrenti di account sospetti. La prima è quella dei profili che impersonano celebrità o personaggi pubblici: nel dataset compaiono decine di falsi account che richiamano Elon Musk, membri della sua famiglia, Donald Trump e suoi familiari, ma anche figure dello spettacolo e della musica.

Una seconda categoria, rilevata soprattutto tra i profili localizzati in Vietnam, è composta da account con nomi anglofoni generici accompagnati da sequenze numeriche finali, una struttura seriale che suggerisce creazione in massa più che attività spontanea.

Un terzo gruppo, emerso tra i profili geolocalizzati a Hong Kong, presenta bio identiche — in alcuni casi la stessa frase ripetuta parola per parola —, zero o quasi zero post, date di creazione ravvicinate e un rapporto fortemente squilibrato tra attività pubblica minima e migliaia di account seguiti.

Più in generale, il tratto comune che attraversa questi cluster è proprio questo: profili quasi inattivi sul piano dei contenuti, ma molto aggressivi sul piano del following, come se la loro funzione non fosse partecipare alla conversazione bensì alterarne i segnali di popolarità.

È qui che la data analysis rafforza in modo decisivo l’ipotesi di coordinamento. Sui 22.082 follower unici rilevati complessivamente per i 21 account ungheresi analizzati, 3.701 compaiono come follower di almeno due account, pari al 16,8% del totale; 155 risultano presenti in almeno 10 account e 41 in almeno 15. In sé, una certa sovrapposizione tra pubblici politicamente affini può anche essere fisiologica. Ma nel report il dato quantitativo si combina con altri indizi: naming seriale, bassissima produzione di contenuti, pattern geografici ricorrenti e riuso di account già osservati nel contesto olandese.

Alcuni tassi di overlap, ovvero la presenza degli stessi follower su più account, sono particolarmente alti: JuditJanosne raggiunge l’86,3%, kosFarag260673 il 75,6%, BollerLeo il 70%, sookymari il 69,9%. Anche l’analisi per coppie mostra concentrazioni anomale, come nel caso di RNascal e UrogdiG, che condividono 887 follower.

Il quadro che ne esce non è quello di una crescita spontanea di comunità politiche affini, ma di una rete che sembra redistribuire gli stessi follower sospetti su più profili, così da aumentarne insieme visibilità, peso e credibilità percepita.

Secondo il report il risultato è la costruzione di una sfera informativa artificiale: contenuti che sembrano sostenuti da un consenso reale vengono in realtà spinti da reti coordinate dall’estero, capaci di falsare la percezione pubblica della popolarità di idee, slogan e attori politici. Quando i sistemi di raccomandazione scambiano questi segnali per interesse autentico, l’effetto è un ecosistema informativo distorto, in cui utenti, giornalisti e decisori finiscono per leggere l’opinione pubblica attraverso numeri alterati.

È per questo che il caso non riguarda solo Olanda e Ungheria: riguarda la vulnerabilità strutturale delle piattaforme davanti a operazioni persistenti, flessibili e poco costose. Stessa infrastruttura, nuova elezione: il segnale più inquietante è che queste reti non scompaiono, ma si riconvertono e tornano in azione dove serve.

Fonti e approfondimenti

Il presente articolo si basa sul report Persistent Infrastructure and Cross-Border Influence Operations Targeting European Elections on X, realizzato da Alliance4Europe e Trollrensics nell’ambito di HEIO – Hybrid Election Integrity Observatory.

Di Emerenziana Sinagra