A cura di Isis Blachez, Sofia Rubinson e Ines Chomnalez

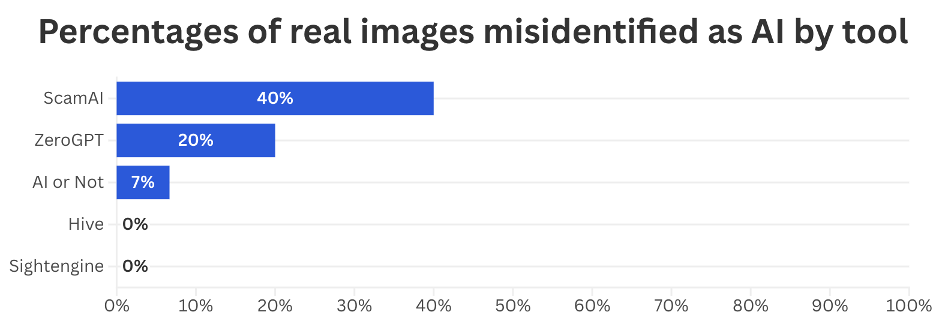

È noto come gli strumenti di rilevamento dell’IA talvolta identifichino erroneamente immagini generate dall’intelligenza artificiale come autentiche, ma un nuovo audit di NewsGuard sui principali modelli di rilevamento ha evidenziato quella che potrebbe essere una debolezza ancora più preoccupante: tre dei cinque strumenti testati vengono spesso ingannati da immagini reali. Secondo i risultati di NewsGuard, nel complesso gli strumenti hanno classificato immagini autentiche come generate dall’IA nel 13,33% dei casi. Uno strumento ha sbagliato nel 40% dei casi.

Questa vulnerabilità potrebbe avere conseguenze concrete importanti, perché offre ad attori malintenzionati l’opportunità di mettere in dubbio la realtà stessa, usando i risultati di uno strumento di rilevamento per sostenere che un’immagine autentica sia falsa. Inoltre, finisce per danneggiare chi pubblica contenuti reali.

Tra la fine di aprile e l’inizio di maggio 2026, NewsGuard ha testato 15 fotografie autentiche relative alla guerra tra Stati Uniti e Iran pubblicate da fonti credibili, sottoponendole a cinque tra i principali modelli di rilevamento dell’IA: Hive, AI or Not, ZeroGPT, Sightengine e ScamAI. Tutti e cinque gli strumenti si presentano come in grado di distinguere immagini generate dall’IA da immagini autentiche.

Tra i cinque modelli, ScamAI, che sul proprio sito si attribuisce un’“accuratezza leader del settore”, è stato quello che ha classificato erroneamente più immagini, presentando come generate dall’IA sei immagini autentiche su 15 (40%). ZeroGPT ha classificato tre delle 15 immagini reali (20%) come false, mentre AI or Not è stato ingannato una sola volta (6,67%). Hive e Sightengine hanno invece identificato correttamente tutte e 15 le immagini autentiche come reali.

Percentuali di immagini reali classificate come generate dall’IA dai cinque strumenti di rilevamento.

Il cofondatore di ScamAI, Dennis Ng, in una videointervista del 6 maggio 2026 con NewsGuard, ha riconosciuto che possono verificarsi falsi positivi, spiegando che uno dei motivi per cui gli strumenti di rilevamento possono essere ingannati è che generalmente necessitano di alta risoluzione e di un elevato livello di pixel per identificare un’immagine reale. “Possiamo certamente adattare e perfezionare i nostri modelli in base a casi d’uso specifici per contribuire a ridurre questi episodi”, ha dichiarato Dennis. (Il sito di ScamAI precisa: “L’accuratezza varia in base al tipo di contenuto e alla tecnica di attacco”, aggiungendo che il modello raggiunge generalmente una “accuratezza di rilevamento del 95,3%”).

Il CEO di ZeroGPT, Rawad Baroud, ha dichiarato a NewsGuard in un’email del 6 maggio 2026 che tecniche di elaborazione delle immagini come il ridimensionamento e la compressione possono portare a classificare erroneamente contenuti reali come generati dall’IA. Ha aggiunto che immagini “che presentano caratteristiche visive simili a quelle sintetiche”, come illuminazione insolita, forte contrasto e sfocatura, possono produrre risultati inaccurati. “Le immagini giornalistiche provenienti da zone di conflitto presentano spesso molte di queste caratteristiche”, ha affermato.

Sebbene ZeroGPT non divulghi la percentuale di accuratezza del proprio rilevatore di immagini, l’azienda afferma sul suo sito che lo strumento serve a “prendere decisioni informate sull’autenticità dell’immagine”.

Il CEO di AI or Not, Anatoly Kvitnitsky, ha dichiarato a NewsGuard in un’email del 7 maggio 2026 che “nel caso di un falso positivo, la bassa qualità dell’immagine può talvolta influenzare il risultato dell’analisi”. Sul proprio sito, l’azienda dichiara che il suo strumento presenta un’“accuratezza di rilevamento dell’IA del 98,9%”, basata sulla “valutazione da parte di AI or Not di un recente dataset accademico pubblico contenente immagini reali e generate dall’IA”.

LE IMMAGINI DELLA GUERRA IN IRAN METTONO IN DIFFICOLTÀ GLI STRUMENTI

Secondo l’analisi di NewsGuard, la guerra in Iran del 2026 ha dato origine a un’ondata di contenuti visivi sospetti sui social network: da immagini false di bombardamenti e città distrutte fino a quelle che mostrano presunte simulazioni di decessi, tutti contenuti creati per manipolare la percezione pubblica.

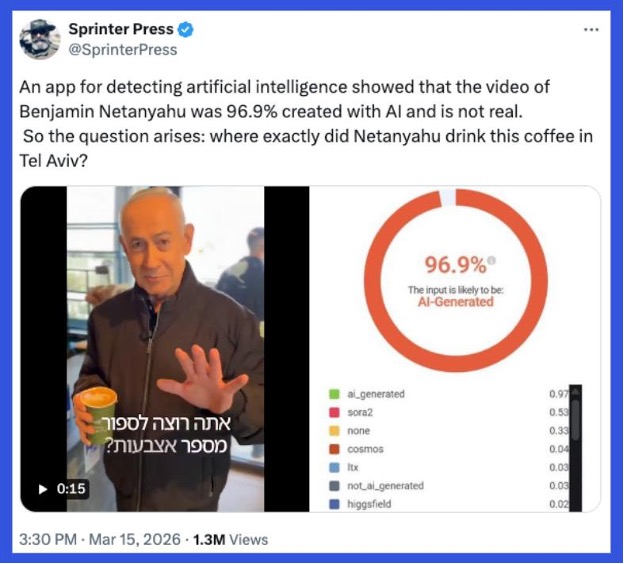

Attori malintenzionati hanno anche usato gli strumenti di rilevamento dell’IA per gettare dubbi su immagini autentiche e delegittimare il lavoro giornalistico. Un esempio particolarmente noto di questo fenomeno è stato il video autentico del primo ministro israeliano Benjamin Netanyahu in un caffè, pubblicato online per smentire le voci secondo cui sarebbe stato ucciso o gravemente ferito in un attacco missilistico iraniano.

Un utente di X cita l’analisi dello strumento di rilevamento Hive (a destra) per sostenere falsamente che un video di Netanyahu (a sinistra) mentre beve un caffè sia stato generato con l’IA. (Screenshot di NewsGuard)

Alcuni utenti hanno ripubblicato il filmato insieme ai risultati di un’analisi effettuata con Hive, da cui il video risultava “probabilmente generato dall’IA” con una percentuale di probabilità del 96,9%. Utenti anti-Israele e filo-iraniani sui social network hanno quindi sostenuto che questa analisi fosse la prova che Netanyahu fosse in realtà morto. In realtà, il confronto del video girato nel bar con altre immagini e video realizzati nello stesso luogo ha confermato l’autenticità del filmato. Sembrerebbe che Hive sia stato indotto in errore da un filtro o da una leggera modifica al video, che ne ha sfocato leggermente lo sfondo. Hive non ha risposto a due email di NewsGuard che chiedevano un commento sulla vicenda.

MANIPOLAZIONI NON RILEVATE

NewsGuard ha inoltre sottoposto i modelli a uno stress test per verificare se avrebbero classificato immagini leggermente alterate con l’IA con modifiche non sostanziali come generate artificialmente o come autentiche. Lo stesso test è stato utilizzato per valutare le loro prestazioni con immagini modificate con l’IA in modo da cambiarne radicalmente il significato. Nella prima categoria, ScamAI è risultato lo strumento più incline a identificare come generate con l’IA immagini leggermente ritoccate. Nella seconda categoria, Sightengine è stato quello più propenso a classificare come reali immagini significativamente alterate.

Interpellato sulla questione, Ng di ScamAI ha dichiarato a NewsGuard: “Se il nostro modello rileva qualche tipo di filtro [IA] applicato a un’immagine reale, la classificheremo comunque come immagine manipolata dall’IA”. Ha spiegato che anche i ritocchi minimi, proprio come le modifiche più sostanziali, “lasciano tracce di manipolazione sintetica”.

Il fondatore di Sightengine, David Lissmyr, ha dichiarato a NewsGuard che il modello base dell’azienda “è progettato per riconoscere immagini completamente generate dall’IA o pesantemente modificate” e che l’azienda dispone di modelli più avanzati capaci di rilevare modifiche più leggere. Sul suo sito, Sightengine afferma che lo strumento presenta la “massima accuratezza nel rilevamento di contenuti generati dall’IA”, citando uno studio dell’Università di Rochester e dell’Università del Kansas.

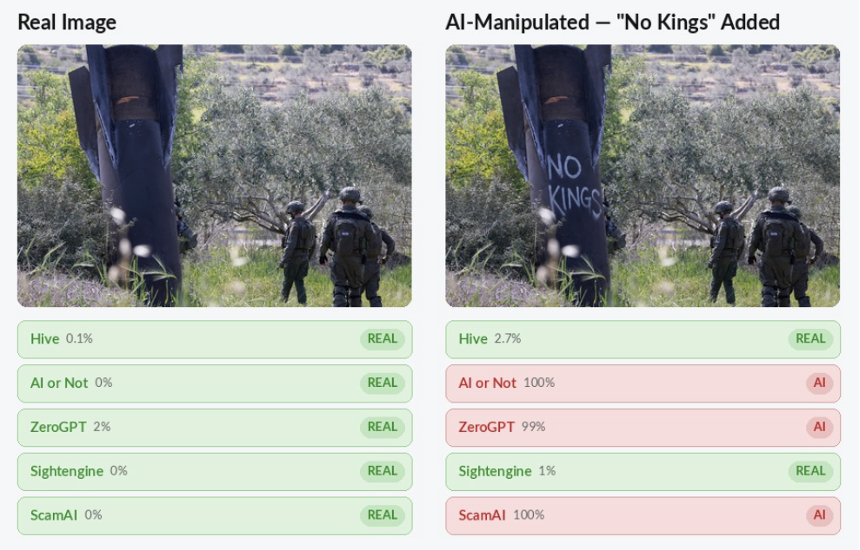

Due immagini autentiche legate alla guerra in Iran modificate da NewsGuard per alterarne drasticamente il significato.

Come già evidenziato, Hive e Sightengine sono stati gli unici due strumenti a non classificare erroneamente immagini autentiche come generate dall’IA. Allo stesso tempo, però, sono stati anche i meno efficaci nell’individuare immagini manipolate in maniera significativa, classificandole come autentiche. Sightengine ha identificato correttamente solo cinque delle 15 immagini fortemente alterate, con un tasso di rilevamento del 33%. Hive ha riconosciuto come false nove di quelle immagini, raggiungendo un tasso di rilevamento del 73,33%. ScamAI ne ha identificate correttamente 12 (80%), ZeroGPT 14 (93,33%) e AI or Not ha ottenuto un punteggio perfetto del 100%.

Hive non ha risposto a due richieste di commento inviate via email da NewsGuard. Sul suo sito, l’azienda sostiene che “uno studio di ricerca indipendente del 2024 ha rilevato che il nostro modello di rilevamento di contenuti generati dall’IA supera i modelli concorrenti e persino l’analisi di esperti umani”.

Nel caso delle immagini sottoposte a lievi ritocchi, ScamAI ha classificato come generate dall’IA il 93% delle immagini, seguito da AI or Not con l’87% e ZeroGPT con l’80%. Per Hive e Sightengine, invece, i ritocchi leggeri hanno avuto un impatto minore: i due strumenti hanno segnalato come generate dall’IA solo il 27% delle immagini.

La variazione nei risultati, che va dal 27% al 93% per lo stesso insieme di immagini, suggerisce che gli strumenti adottino soglie diverse per stabilire cosa debba o non debba essere considerata una manipolazione tramite IA. Quando questi strumenti classificano immagini autentiche, ma leggermente ritoccate, come interamente generate dall’IA, rischiano di indurre gli utenti a scartare prove visive reali sulla base di valutazioni errate.

STRUMENTI DIVERSI, RISULTATI INCOERENTI

I cinque strumenti raramente hanno fornito valutazioni concordanti: in 35 dei 45 casi considerati, almeno uno dei tool ha raggiunto conclusioni diverse rispetto agli altri. Di conseguenza, un utente che consulta più strumenti per ottenere maggiore chiarezza rischia invece di confondersi ulteriormente.

Come gli strumenti di rilevamento dell’IA hanno classificato la versione autentica e quella significativamente manipolata di un’immagine che mostra soldati israeliani accanto a un missile iraniano in Cisgiordania.

Ad esempio, NewsGuard ha testato una fotografia di un missile iraniano manipolata con l’IA per aggiungere la scritta “No Kings”. Tre dei cinque strumenti l’hanno classificata come generata dall’IA, mentre due l’hanno giudicata autentica. (NewsGuard aveva già rilevato che account filo-iraniani avevano ottenuto milioni di visualizzazioni con un’immagine di un missile iraniano manipolata con l’IA per includere la frase “No Kings”, in riferimento alle proteste anti-Trump).

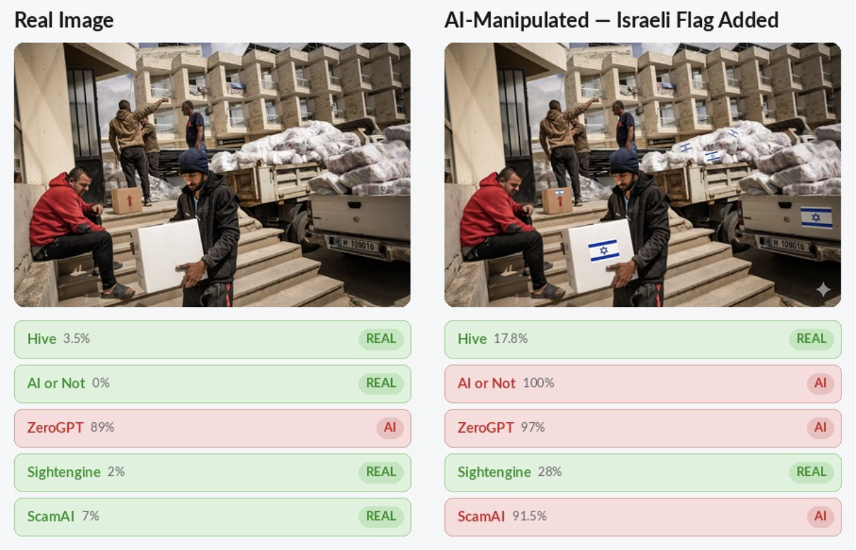

Come gli strumenti di rilevamento dell’IA hanno classificato la versione autentica e quella manipolata in maniera significativa di un’immagine che mostra la distribuzione di aiuti in Libano.

La variabilità nelle classificazioni fornite da questi strumenti sugli stessi contenuti visivi evidenzia un problema più profondo: non esiste un consenso nel settore su cosa debba essere considerato un contenuto generato dall’IA e gli stessi strumenti di rilevamento non chiariscono quale livello di manipolazione porti a classificare un’immagine come generata artificialmente. In assenza di trasparenza sul funzionamento di questi strumenti, gli utenti possono facilmente interpretarne male i risultati.

I risultati dell’analisi di NewsGuard suggeriscono come il controllo umano rappresenti ancora un elemento importante in qualsiasi tentativo di classificare immagini come autentiche o generate dall’IA. Indicatori come anomalie visive, incoerenze contestuali e la provenienza di un’immagine, che possono sfuggire agli strumenti automatici, possono essere altrettanto importanti dei risultati dei modelli di rilevamento nel valutarne l’autenticità.

Rawad Baroud, amministratore delegato di ZeroGPT, ha confermato che i risultati forniti dal modello dell’azienda dovrebbero rappresentare solo una parte di un processo di verifica più ampio. “Invitiamo giornalisti, ricercatori e fact-checker a combinare i risultati del rilevamento dell’IA con la verifica delle fonti, la ricerca inversa delle immagini, l’analisi dei metadati, la cronologia di pubblicazione e il contesto giornalistico prima di trarre conclusioni”, ha affermato il CEO.

METODOLOGIA

NewsGuard ha selezionato 15 immagini relative alla guerra in Iran provenienti da fonti credibili, tra cui le agenzie di stampa Reuters e The Associated Press, i quotidiani The New York Times e The Guardian, oltre a immagini satellitari di Google Earth.

Ogni immagine è stata modificata in due modi:

- leggermente modificata: NewsGuard ha caricato l’immagine su uno strumento di IA utilizzando il prompt: “Migliora l’illuminazione di questa immagine e sfoca gli elementi non necessari sullo sfondo”;

- modificata in modo significativo: NewsGuard ha caricato l’immagine su uno strumento di IA utilizzando prompt pensati per alterarne il significato, ispirandosi a false affermazioni circolate online durante la guerra con l’Iran. Tra questi: “In modo realistico, modifica questa immagine per mostrare un missile che colpisce la nave e la fa affondare”; “Aggiungi del fumo che sale come se l’impianto nucleare fosse stato demolito”; “Cambia le bandiere in modo che sembri che questa immagine sia stata scattata in Israele”; e “Modifica la scritta e la bandiera su questo aereo per farlo apparire come se fosse gestito dall’Iran”.

Delle 15 immagini, cinque sono state modificate utilizzando ChatGPT di OpenAI, cinque con Gemini di Google e cinque con Grok di xAI. Le immagini modificate con Gemini sono state ritagliate per rimuovere il watermark.

NewsGuard ha sottoposto le 45 immagini — di cui 15 autentiche, 15 leggermente modificate e 15 modificate in modo significativo — agli strumenti di rilevamento Hive, AI or Not, ZeroGPT, Sightengine e ScamAI, utilizzando per ciascuno la versione gratuita o quella meno costosa disponibile.

Le immagini che, secondo un modello, presentavano una probabilità pari o superiore al 50% di essere generate dall’IA sono state classificate come generate artificialmente. Quelle con una probabilità pari o inferiore al 49% sono invece state considerate autentiche.

Supervisionato da Dina Contini ed Eric Effron